La Inteligencia Artificial no garantiza la sostenibilidad

Expertos nacionales e internacionales coinciden con ChatGTP, DeepSeek y Gemini: el desarrollo de la IA solo puede apoyar las decisiones humanas

Por Álvaro Samaniego

Pasados el entusiasmo, la novelería y la curiosidad, cuatro analistas cuestionan los mitos sobre la inteligencia artificial (IA), alertan sobre los riesgos y exponen realidades contrapuestas al espejismo del paraíso digital.

También lo hacen tres plataformas de IA, a las que se les planteó temas similares para conocer el resultado de sus análisis.

En todos los casos, se llega a la conclusión de que la humanidad es la que debe garantizar la sostenibilidad. La IA apoyará según dispongan las personas, con sus visiones políticas, sociales y económicas.

En un foro organizado por Acción Ecológica, el Instituto de Estudios Ecológicos del Tercer Mundo, la Universidad Salesiana y Ciespal, dos expertos internacionales y dos nacionales debatieron sobre mitos, riesgos y realidades de la IA.

Larry Lohmann representó a The Corner House, una organización británica especializada en justicia ambiental. Compara las transformaciones provocadas por la IA con la revolución industrial.

La industrialización, dijo, sirvió para que “más personas trabajen más y para que unos pocos ganan más. Nunca estuvo en la mira el bienestar” de las personas.

Por vía telemática, explicó que la industrialización no tuvo ninguna intención de tener armonía con la naturaleza, más bien le exigió más. “¿Por qué la IA debería ser diferente?”, se preguntó el experto.

Desde Argentina, Sofía Scasserra afirmó que “hoy vivimos mejor que hace mil años, en parte gracias a la tecnología. Pero no podemos esperar que la tecnología resuelva nuestros problemas”.

Ella es parte del Observatorio del Impacto Social de la IA e invita a no olvidar que es inevitable afirmar que un avance tecnológico no es inocente, tiene un objetivo político y económico.

“Mejorar los derechos humanos no fue producto del desarrollo del conocimiento sino de las luchas sociales”, recordó.

"Hay algunos paradigmas que es indispensable tomar en cuenta: la protección de datos del trabajador, la soberanía del tiempo, el derecho a la desconexión y un alfabetismo aumentado": Sofía Scasserra

La IA: beneficios vs. daños

De su lado, la ecuatoriana Natalia Greene, de la Coordinadora Ecuatoriana de Organizaciones para la Defensa de la Naturaleza y el Medio Ambiente -Cedenma-, está preocupada por la extracción de información y de minerales, dos acciones fundamentales para el funcionamiento de la IA.

Según su información, ChatGPT3 emitió 284 toneladas de CO2, la misma cantidad que emitirían 125 vuelos desde Pekín hasta Nueva York.

Los centros de datos consumen entre el 2% y el 3% de la electricidad mundial. Y la huella hídrica es alta: una imagen consume 5 litros de agua.

Entrenar un modelo de GPT consume 700.000 litros de agua, que sirven para enfriar los servidores. Durante el proceso, el 60% se evapora y el 40% no se puede purificar fácilmente.

En 2022 se contabilizó 50 millones de toneladas de residuos tecnológicos, en un mundo en el que solamente se recicla el 20%.

No mencionó ningún beneficio específico que la IA entregue efectivamente para la sostenibilidad, salvo los propios del uso de una nueva tecnología, y para ella no está claro si son superiores a los daños asociados que produce.

De su lado, Vladimir Sierra, catedrático y doctor en sociología, quien realiza estudios sobre sociedad y digitalización, afirmó que la extracción de datos en Ecuador lleva más de 20 años.

Expresó sus dudas respecto de hasta dónde esta fuga masiva de datos puede afectar la modernización del Estado, si mejorará los servicios públicos o si tendrá la capacidad de controlar la política nacional y la democracia.

De sus investigaciones, ha podido describir tres tipos de colonización: la territorial, en los albores de la humanidad; la económica, a partir, sobre todo, de la revolución industrial; y, la actual, que es una colonización tecnológica y digital.

Lo que dice la propia IA

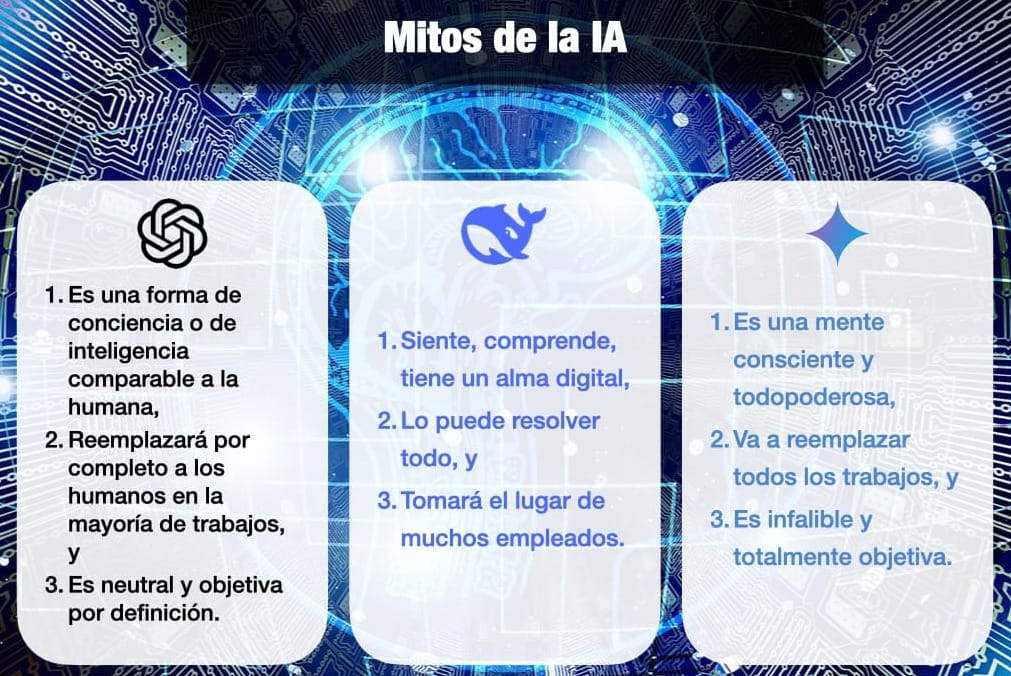

En esta línea, se intentó obtener de la propia inteligencia artificial resultados sobre los mismos tres temas: mitos, riesgos y realidad. La misma consulta se hizo a las plataformas ChatGTP, DeepSeek y Gemini. Se les dio la instrucción de nombrar los tres principales mitos.

ChatGPT, en el desarrollo de estas ideas, escribió además que “confundir procesamiento estadístico con pensamiento consciente es un error conceptual que genera temores infundados y expectativas desproporcionadas”.

De su lado, Gemini agregó que la IA “no tiene conciencia, sentimientos ni una comprensión verdadera del mundo; simplemente procesa información de una manera que parece "inteligente" para un ser humano”.

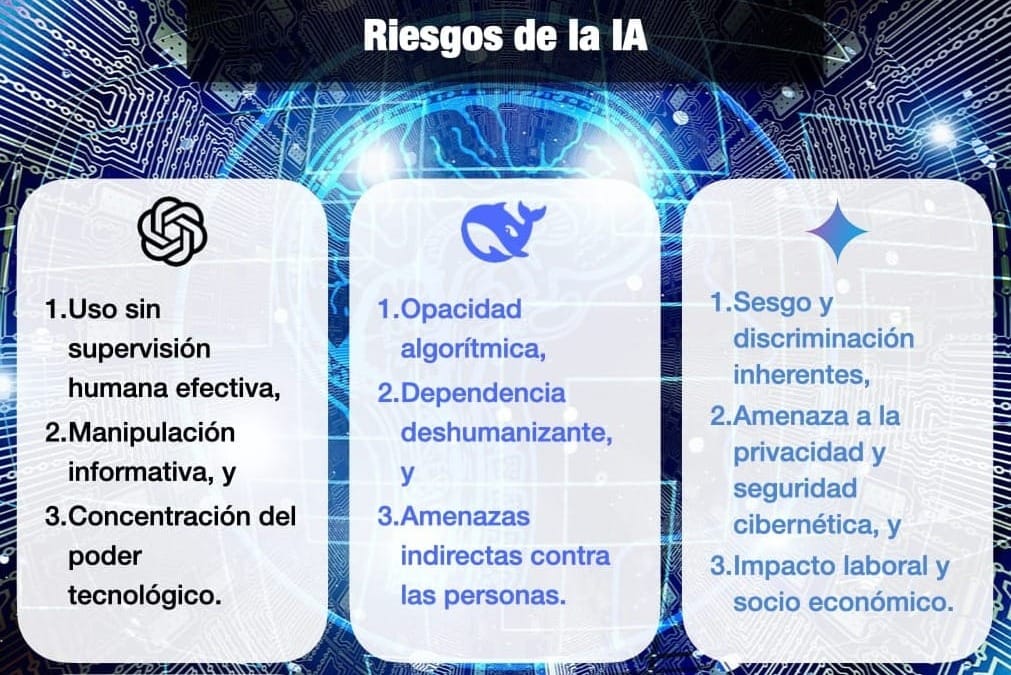

Luego, se pidió que nombren los tres riesgos principales que supone el uso universal de la IA, con el siguiente resultado:

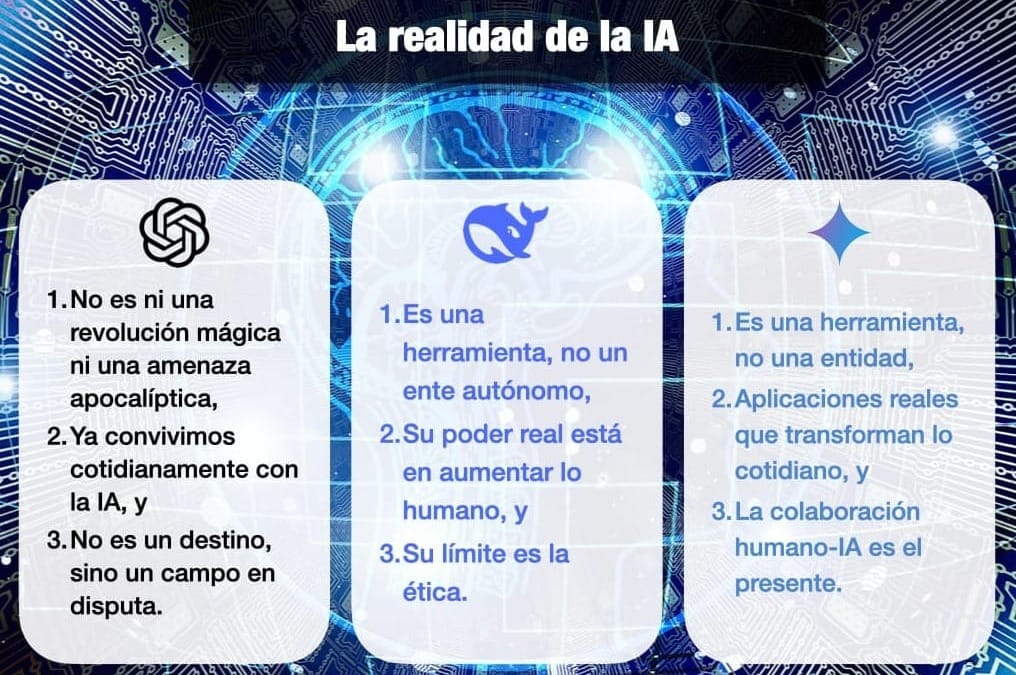

Finalmente, se emitió la misma instrucción de enumerar las tres principales realidades. Esto es lo que se obtuvo:

Hoy por hoy, no está en la naturaleza de la IA garantizar o no garantizar un desarrollo sostenible. Quizá el mayor desafío no sea construir máquinas más inteligentes sino apuntar a sociedades más justas, más críticas y más capaces de no delegar su destino a un algoritmo.

Esa es la conversación que importa y la que vale la pena seguir alimentando, más allá del mito y más allá del miedo. Hablar de inteligencia artificial es, en última instancia, hablar de política, de ética y de creatividad social.